アップステージLLM、「Solar Mini」パフォーマンスレポート

2023/01/25 | 3分小さくてもパワフル、アップステージ独自のLLMモデル「Solar Mini」。

30B未満モデルで圧倒的なトップ

世界が認めたLLM、「Solar(ソーラー)」の時代が到来しました。Solarはアップステージが開発した大規模言語モデル(Large Language Model, LLM)で、昨年12月、Hugging FaceのOpen LLMリーダーボードで1位を獲得して話題を集めました。 Solar Miniはコンパクトなサイズでありながら、GPT-3.5と同様のレベルの回答を2.5倍速い速度で提供します。Solar MiniがLLMモデルのサイズを革新的に縮小しながら性能を維持することができた方法をご紹介します。

ソーラーの強み

小型LLMが必要な理由

大規模言語モデル(Large Language Models, LLMs)を実際のアプリケーションに統合する上で、サイズは非常に重要な要素となっています。 小さなモデルを使用すると、計算時間を効果的に短縮することができ、結果値の出力にかかる時間が減り、応答性と効率が向上します。このような効果により、特定の分野やサービスに合わせて使用する場合でも、最適化に必要な人員やリソースも削減できます。 また、サイズが小さいと、デバイス内にLLMを入れるオンデバイスAIも可能になり、ユーザーのローカルデバイスに直接AI機能を提供できるようになります。オンデバイスでLLMを使用することは、アクセシビリティを向上させるだけでなく、GPUリソースへの依存を減らし、リーズナブルな価格で高性能なAIソリューションを導入できる新しい道を開きます。

Solarの応答速度

コンパクトサイズ、パワフルな性能

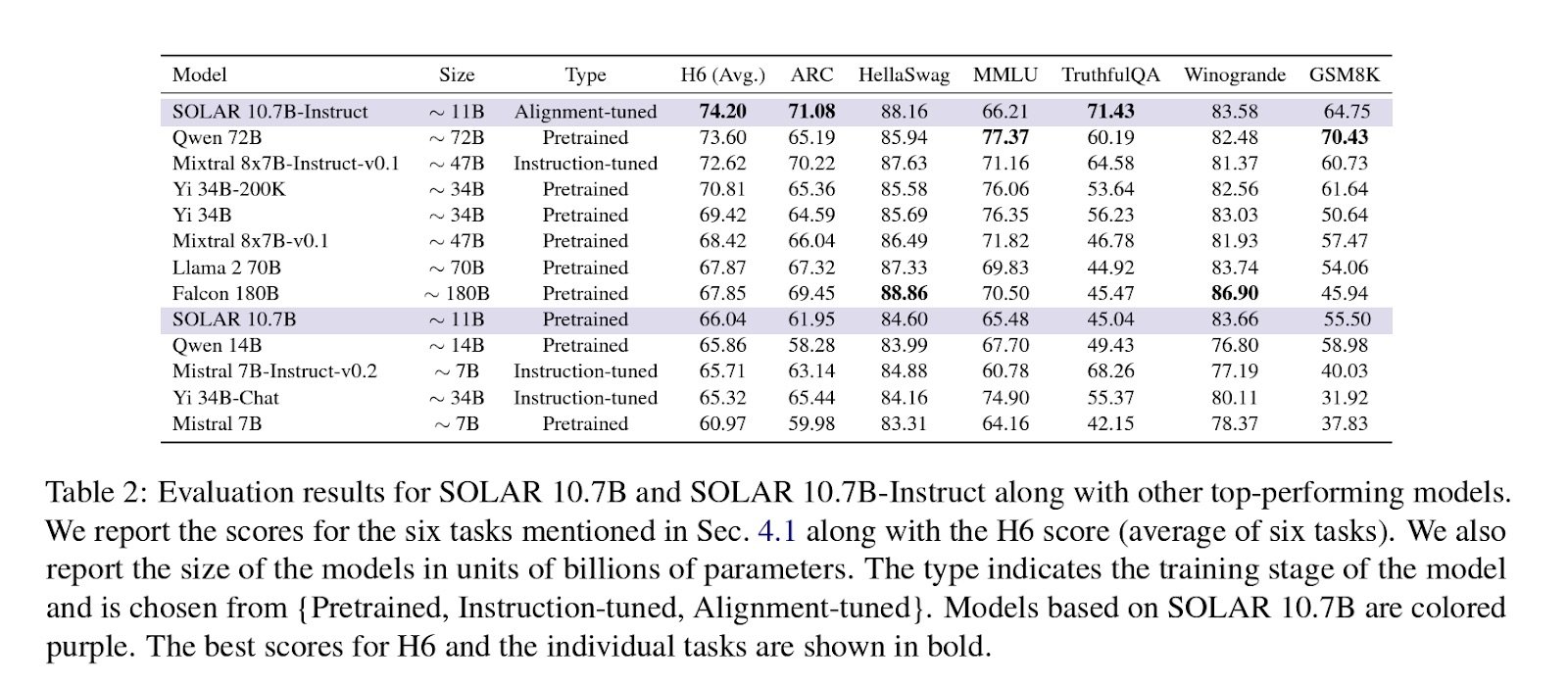

Solar Miniは、優れた性能に大きなサイズは必要ないことを証明しています。Llama2、Mistral 7B、Ko-Alpaca、KULLMなどの競合他社をさまざまなベンチマークで上回りました。

Solar 10.7BとSolar 10.7B-Instructモデルのベンチマークデータセットの評価結果(出典:SOLAR 10.7B: Scaling Large Language Models with Simple yet Effective Depth Up-Scaling)

Solar Miniの構築プロセス

基本構造

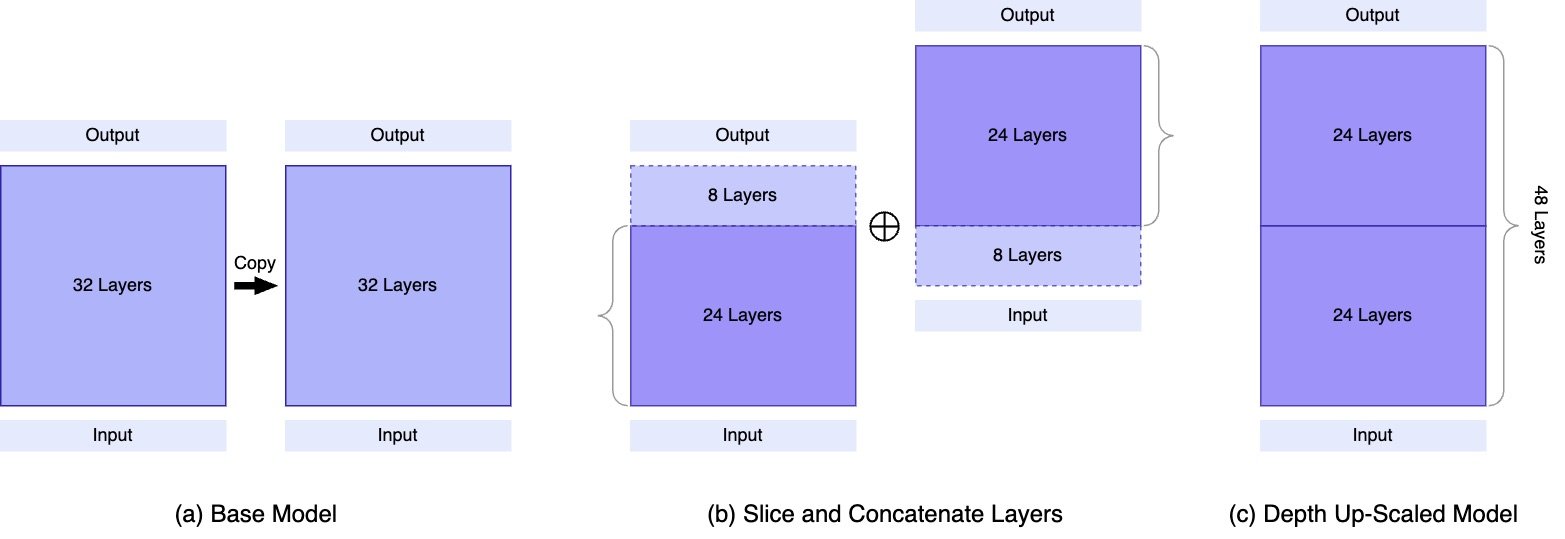

Solar Miniの基本アーキテクチャは32 Layer Llama2構造をベースにしており、Llama2アーキテクチャと互換性のある最高性能モデルの一つであるMistral 7Bの事前訓練された重みでトレーニングを開始します。

Solar Miniはどのようにしてコンパクトなサイズを維持しながら、驚くほどパワフルになったのでしょうか?私たちのスケーリング方法である「Depth Up-scaling」(DUS)は、深度別スケーリングと継続的な事前トレーニングで構成されています。DUSは、他のスケーリング方法よりもはるかにシンプルで効率的な小型モデルの拡張を可能にします。

Mixture of Experts (MoE)とは異なり、DUSは複雑な変更を必要とせず、追加のモジュールや動的要素なしですぐに互換性があり、Hugging Faceなどの使いやすいLLMフレームワークとすべてのトランスフォーマーアーキテクチャに適用可能です。

Continued Pre-training (継続的な事前学習)

Depth Up-scaling直後はモデルの性能がベースLLMより低下します。 したがって、拡張されたモデルの性能を回復するために継続的な事前学習を行うことになります。

インストラクションチューニング

この段階では、モデルは特に韓国語に対するInstruction Tuningを行い、韓国語能力を向上させます。LLMがクエリの指示に正確に従うように訓練させるために、質問と回答形式でチューニングする過程です。

アライメントチューニング

Instruction Tunedされたモデルは、人間や既存の強力なLLMが好む回答に適した答えを出すようにチューニングされます。

コンポーネントと一緒にSolarを使う

RAG

Solar Miniは特にRAG(Retrieval-Augmented Generation)システムとうまく機能します。LLMのサイズが大きい場合、LLMは事前に学習した知識に頼って質問に答える傾向があります。小型モデルであるSolar Miniは、RAGをより効果的に活用し、出力の精度と関連性を高めることで、その精度と信頼性を強化します。

Solar Miniと一緒に使用できるコンポーネントとして、ドキュメントの形式を読み取るLayout Analyzerもあります。あらゆる文書から表と図を抽出するこのモデルは、PDF、PNG、JPGデータをOCRおよびレイアウト分析モジュールで処理します。複雑な形式の文書も、人間が読む方向と方法でHTMLに変換することで、LLMに直接入力できるデータ形式になります。

最後に

Solar Miniは、コンパクトなサイズをベースに様々なサービスと新しいビジネスの試みに適用できる強みを持っています。速いスピードだけでなく、高いドメインおよびサービス適用性、そしてオンデバイスの可能性に至るまで、多才なSolarの発展を期待してください。

もっと詳しく : ソーラー論文/(日本語) Hugging Face/ Hugging Face ポー

Solar MiniはApache 2.0ライセンスの下で公開されています。

☀️ Solar LLM

費用対効果が高く、軽くてパワフルなSolar Miniをお試しください!

アップステージの小さいながらも強力なSolarの性能と導入方法をもっと知りたい方は?